Terrore dei Mercati di fronte al DeepSeek, il sistema cinese che costa il 97% in meno dei loro e consuma meno… I privati che credevano che la ricerca del profitto fosse la guida per scegliere l’innovazione migliore, scoprono ora di aver sbagliato il mega-investimento più importante della storia – e che gli USA sono tecnologicamente arretrati.

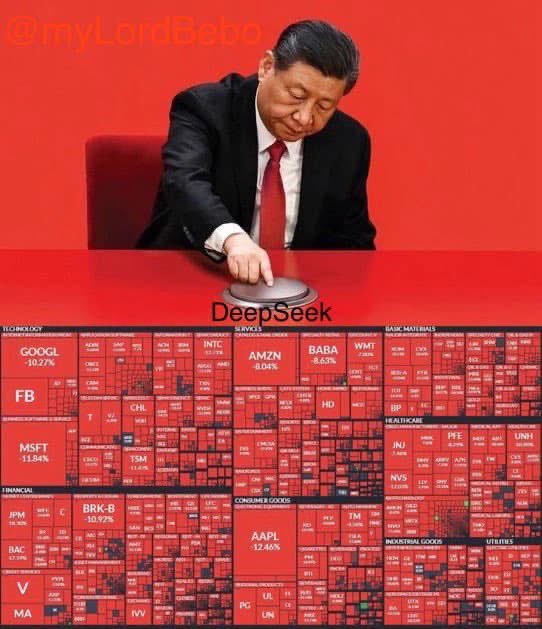

La Cina ha trasformato l’intero mercato azionario statunitense in un bagno di sangue con DeepSeek 1 trilione di dollari persi

Alcuni titoli:

I mercati globali crollano per il panico dell’intelligenza artificiale cinese a basso costo

I future azionari statunitensi e i mercati globali stanno crollando, mentre i crescenti timori del fine settimana che la piattaforma AI R1 di DeepSeek della Cina possa portare a un crollo dei piani di spesa in conto capitale, hanno portato a una disfatta all’ingrosso di nomi tecnologici in tutto il mondo. E poiché la tecnologia è di gran lunga il settore più importante per le azioni globali, non è stato risparmiato quasi nulla (con la possibile eccezione del settore energetico che per mesi è stato utilizzato come coppia di trading per finanziare posizioni lunghe nel settore tecnologico). Di conseguenza, quello che alle 18:00 di domenica sera (quando sono stati aperti i futs) era un semplice rivolo di DeepSelling…

DeepSeek costringe gli investitori a “mettere in discussione la posizione di mercato di tutti i nomi MegaCap Tech e dell’intera filiera di fornitura AI”. I nomi Mag7 stanno tutti precipitando prima del mercato del 4-6% mentre alcuni ex leader stanno venendo completamente distrutti come NVDA -11%, AVGO -10,8%, VRT -18%. Il panico globale per il rischio significa che i rendimenti obbligazionari stanno crollando mentre l’USD si sta muovendo verso il basso e le materie prime sono contrastanti.

L’angoscia su DeepSeek è emersa nel fine settimana, con gli analisti tecnologici che affermano che il modello di intelligenza artificiale dell’azienda offre prestazioni paragonabili ai migliori chatbot del mondo a una frazione del prezzo. Per alcune riflessioni, vedere qui:

L'”intelligenza artificiale a basso costo” è un evento Cigno Nero?

Goldman chiede se DeepSeek della Cina sia il momento Sputnik dell’intelligenza artificiale

DeepSeek: i mercati sono in una situazione di merda o è solo un calo?

DeepSeek tira il tappeto da sotto Nvidia e ASML

- Goldman Asks If China’s DeepSeek is AI’s Sputnik Moment

- DeepSeek: Are Markets in Deep Shit or is This Just a Blip-Dip?

- DeepSeek Pulls Rug Out On Nvidia, ASML

Per gli investitori, ha messo un punto interrogativo su un rally guidato dall’intelligenza artificiale che ha aggiunto 15 trilioni di dollari al Nasdaq 100 dal 2022 ed è stato al centro dei guadagni azionari statunitensi.

“Sottopone a un esame molto approfondito il livello delle valutazioni”, ha affermato Benedicte Lowe, stratega dei derivati azionari presso BNP Paribas Markets 360. “Siamo piuttosto positivi sul settore azionario tecnologico statunitense. Ma ciò mette pressione sulle prospettive e rappresenta un punto di svolta per le aziende in questa fase del ciclo”.

La tecnologia rimarrà al centro dell’attenzione dei trader, con quattro dei Magnifici Sette titoli azionari (Apple, Microsoft, Meta e Tesla) che pubblicheranno i risultati questa settimana. “Con DeepSeek che probabilmente rimarrà nella mente degli investitori, guadagni smorzati per i battiti e punizioni severe per i fallimenti potrebbero essere il risultato della stagione degli utili”, ha affermato Patrick Armstrong, responsabile degli investimenti presso Plurimi Wealth LLP.

In Europa, ASML Holding NV è scesa del 10%, la più grande svendita da ottobre, pesando sullo Stoxx 600 europeo, che è sceso dello 0,6%.

![]()

DeepSeek può innescare un “impatto negativo sui Capex” mentre le previsioni di picco dell’occupazione dei data center affrontano una revisione

Come i cinesi battono Trump e aprono l’AI

Due giorni fa Trump ha annunciato Stargate, un investimento da 500 miliardi di dollari in infrastrutture di intelligenza artificiale negli Stati Uniti:

Martedì tre importanti aziende tecnologiche hanno annunciato che creeranno una nuova società, chiamata Stargate, per far crescere l’infrastruttura di intelligenza artificiale negli Stati Uniti.

Il CEO di OpenAI Sam Altman, il CEO di SoftBank Masayoshi Son e il presidente di Oracle Larry Ellison sono comparsi alla Casa Bianca martedì pomeriggio insieme al presidente Donald Trump per annunciare la società, che Trump ha definito il “più grande progetto di infrastruttura di intelligenza artificiale della storia”.

Le società investiranno 100 miliardi di dollari nel progetto per iniziare, con l’intenzione di versare fino a 500 miliardi di dollari in Stargate nei prossimi anni. Si prevede che il progetto creerà 100.000 posti di lavoro negli Stati Uniti, ha affermato Trump.

Stargate costruirà “l’infrastruttura fisica e virtuale per alimentare la prossima generazione di intelligenza artificiale”

Ellison ha detto che il primo progetto di dati del gruppo, di 1 milione di piedi quadrati, è già in costruzione in Texas.

Lo stesso giorno, ma con molto meno rumore, un’azienda cinese ha pubblicato un altro modello di intelligenza artificiale:

Presentiamo i nostri modelli di ragionamento di prima generazione, DeepSeek-R1-Zero e DeepSeek-R1. DeepSeek-R1-Zero, un modello addestrato tramite apprendimento di rinforzo su larga scala (RL) senza messa a punto supervisionata (SFT) come fase preliminare, ha dimostrato prestazioni notevoli.

L’hype intorno all’Intelligenza Artificiale, l’ormai fallito tentativo degli Stati Uniti di monopolizzarla, e il recente contatore dalla Cina sono una lezione su come innovare. Mostrano anche che gli Stati Uniti stanno perdendo la capacità di farlo.

A metà del 2023, quando l’hype di Intelligenza Artificiale ha guadagnato titoli, ho scritto:

L’intelligenza artificiale è (più “piùtamente) riconoscimento del modello glorificato

Attualmente c’è un po ‘di hype su una famiglia di modelli di linguaggio di grandi dimensioni come ChatGPT. Il programma legge l’input del linguaggio naturale e lo elabora in alcuni contenuti del linguaggio naturale. Questo non è nuovo. La prima Entità Informatica Linguistica Artificiale (Alice) è stata sviluppata da Joseph Weizenbaum al MIT nei primi anni ’60. Ho avuto chat divertenti con ELIZA Negli anni ’80 su un terminale mainframe. ChatGPT è un po ‘più niftier e i suoi risultati iterativi, cioè le “conversazioni” che crea, possono anche stupire alcune persone. Ma il clamore intorno ad esso è ingiustificato.

…

Attualmente la correttezza fattuale dell’output dei migliori modelli di linguaggio di grandi dimensioni è stimata all’80%. Elaborano simboli e modelli, ma non hanno alcuna comprensione di ciò che questi simboli o modello rappresentano. Non possono risolvere problemi matematici e logici, nemmeno molto basilari.

Esistono applicazioni di nicchia, come la traduzione di lingue scritte, in cui l’intelligenza artificiale o il riconoscimento dei modelli ha risultati sorprendenti. Ma non si può ancora fidare di loro per ottenere ogni parola giusta. I modelli possono essere assistenti ma si dovrà sempre ricontrollare i propri risultati.

Nel complesso, la correttezza degli attuali modelli di intelligenza artificiale è ancora troppo bassa per consentire loro di decidere qualsiasi situazione del mondo reale. Più dati o più potenza di calcolo non cambieranno questo. Se si vogliono superare i propri limiti, si dovrà trovare alcune idee fondamentalmente nuove.

Ma l’hype continuò. Un grande modello di intelligenza artificiale, ChatGPT, è stato fornito da un’organizzazione senza scopo di lucro, OpenAI. Ma il suo CEO, Sam Altman, annusò presto la grande quantità di dollari che potenzialmente poteva fare. Un anno dopo aver difeso la struttura no-profit di OpenAI Altman ha effettivamente fatto irruzione nel consiglio di amministrazione e ha preso l’organizzazione privata

Forbes:

DeepSeek: gli innovatori dell’IA della Cina stanno sfidando lo status quo

I controlli sulle esportazioni statunitensi sui semiconduttori avanzati erano destinati a rallentare i progressi dell’IA in Cina, ma potrebbero aver inavvertitamente stimolato l’innovazione. Incapaci di affidarsi esclusivamente agli ultimi hardware, aziende come DeepSeek di Hangzhou sono state costrette a trovare soluzioni creative per fare di più con meno.

Inoltre, la Cina sta perseguendo una strategia open source ed emergendo come uno dei maggiori fornitori di potenti modelli di intelligenza artificiale completamente open source nel mondo.

Questo mese, DeepSeek ha rilasciato il suo modello R1, utilizzando tecniche avanzate come l’apprendimento di puro rinforzo per creare un modello che non è solo tra i più formidabili del mondo, ma è completamente open source, rendendolo disponibile per chiunque nel mondo per esaminare, modificare e costruire.

DeepSeek-R1 dimostra che la Cina non è fuori dalla corsa all’IA e, in effetti, potrebbe ancora dominare lo sviluppo globale dell’IA con la sua sorprendente strategia open source. Con i modelli competitivi open-sourcing, le aziende cinesi possono aumentare la loro influenza globale e potenzialmente modellare gli standard e le pratiche internazionali di IA. I progetti open source attraggono anche talenti e risorse globali per contribuire allo sviluppo dell’IA cinese. La strategia consente inoltre alla Cina di estendere la sua portata tecnologica nei paesi in via di sviluppo, incorporando potenzialmente i suoi sistemi di intelligenza artificiale – e per estensione, i suoi valori e le sue norme – nell’infrastruttura digitale globale.

Le prestazioni di DeepSeek-R1 sono paragonabili ai principali modelli di ragionamento di OpenAI in una serie di compiti, tra cui matematica, codifica e ragionamento complesso. Ad esempio, sul benchmark matematico AIME 2024, DeepSeek-R1 ha ottenuto un punteggio del 79,8% rispetto al 79,2% di OpenAI-o1. Sul benchmark MATH-500, DeepSeek-R1 ha raggiunto il 97,3% rispetto al 96,4%. Nelle attività di codificazione, DeepSeek-R1 ha raggiunto il paragrafo 6,3esimo percentile sulle codeforze, mentre o1 ha raggiunto il 96,6esimo percentile, anche se è importante notare che i risultati di riferimento possono essere imperfetti e non dovrebbero essere sopravvissuti.

Ma la cosa più notevole è che DeepSeek è stato in grado di raggiungere questo obiettivo in gran parte attraverso l’innovazione piuttosto che affidarsi agli ultimi chip per computer.

Hanno introdotto MLA (attenzione latente a più teste), che riduce l’utilizzo della memoria a solo il 5-13% dell’architettura MHA (attenzione multi-testa). MHA è una tecnica ampiamente utilizzata nell’intelligenza artificiale per elaborare più flussi di informazioni contemporaneamente, ma richiede molta memoria.

Per rendere il loro modello ancora più efficiente, DeepSeek ha creato la struttura DeepSeekESparse. “MoE” sta per Mixture-of-Experts, il che significa che il modello utilizza solo un piccolo sottoinsieme dei suoi componenti (o “esperti”) per ogni attività, invece di eseguire l’intero sistema. La parte “sparsa” si riferisce a come vengono attivati solo gli esperti necessari, risparmiando potenza di calcolo e riducendo i costi.

L’architettura di DeepSeek-R1 ha 671 miliardi di parametri, ma solo 37 miliardi vengono attivati durante il funzionamento, dimostrando una notevole efficienza computazionale. La società ha pubblicato un rapporto tecnico completo su GitHub, che offre trasparenza nel processo di architettura e formazione del modello. Il codice open source di accompagnamento include l’architettura del modello, la pipeline di formazione e i componenti correlati, consentendo ai ricercatori di comprendere e replicare appieno il suo design.

Queste innovazioni consentono al modello di DeepSeek di essere sia potente che significativamente più conveniente rispetto ai suoi concorrenti. Ciò ha già innescato una guerra dei prezzi di inferenza in Cina, che probabilmente si riverserà nel resto del mondo.

DeepSeek addebita una piccola frazione di ciò che OpenAI-o1 costa per l’utilizzo delle API. Questa drastica riduzione dei costi potrebbe potenzialmente democratizzare l’accesso alle capacità avanzate di intelligenza artificiale, consentendo alle organizzazioni più piccole e ai singoli ricercatori di sfruttare potenti strumenti di intelligenza artificiale che in precedenza erano fuori dalla portata.

DeepSeek ha anche aperto la strada alla distillazione delle capacità del suo grande modello in modelli più piccoli ed efficienti. Questi modelli distillati, che vanno da 1,5 miliardi a 70B, sono anche open source, fornendo alla comunità di ricerca strumenti potenti ed efficienti per ulteriori innovazioni.

Ripropendo i loro modelli liberamente disponibili per uso commerciale, distillazione e modifica, DeepSeek sta costruendo buona volontà all’interno della comunità globale dell’IA e stabilendo potenzialmente nuovi standard per la trasparenza nello sviluppo dell’IA.

DeepSeek è stata fondata da Liang Wenfeng, 40 anni, uno dei principali investitori quantitativi della Cina. Il suo hedge fund, High-Flyer, finanzia la ricerca sull’intelligenza artificiale della società.

In una rara intervista in Cina, il fondatore di DeepSeek Liang ha emesso un avvertimento a OpenAI: “Di fronte alle tecnologie dirompenti, i fossati creati da fonti chiuse sono temporanei. Anche l’approccio di OpenAI non può impedire ad altri di recuperare”.

DeepSeek fa parte di una tendenza crescente delle aziende cinesi che contribuiscono al movimento globale di intelligenza artificiale open source, contrastando la percezione che il settore tecnologico cinese si concentra principalmente sull’imitazione piuttosto che sull’innovazione.

A settembre, la cinese Alibaba ha presentato oltre 100 nuovi modelli di intelligenza artificiale open source come parte della famiglia Qwen 2.5, che supportano oltre 29 lingue. Il gigante cinese della ricerca Baidu ha la serie Ernie, Zhipu AI ha la serie GLM e MiniMax la famiglia MiniMax-01, tutti offrendo prestazioni competitive a costi significativamente inferiori rispetto ai principali modelli statunitensi.

Mentre la Cina continua a investire e promuovere lo sviluppo dell’IA open source, mentre allo stesso tempo affronta le sfide poste dai controlli sulle esportazioni, è probabile che il panorama tecnologico globale vedrà ulteriori cambiamenti nelle dinamiche di potere, nei modelli di collaborazione e nelle traiettorie dell’innovazione. Il successo di questa strategia potrebbe posizionare la Cina come una forza trainante nel plasmare il futuro dell’IA, con conseguenze di vasta portata per il progresso tecnologico, la competitività economica e l’influenza geopolitica.

Nature

Il modello cinese e aperto DeepSeek entusiasma gli scienziati

DeepSeek-R1 svolge compiti di ragionamento allo stesso livello di o1 di OpenAI ed è aperto all’esame dei ricercatori.

Chiamato DeepSeek-R1 è un entusiasmante scienziato come un rivale accessibile e aperto a modelli “ragionabili” come OpenAI o1.

Questi modelli generano risposte passo dopo passo, in un processo analogo al ragionamento umano. Questo li rende più abili dei modelli linguistici precedenti per risolvere i problemi scientifici e potrebbe renderli utili nella ricerca. I test iniziali di R1, pubblicati il 20 gennaio, mostrano che le sue prestazioni su determinati compiti in chimica, matematica e codifica sono alla pari con quelli di o1 – che ha entusiasmato i ricercatori quando è stato rilasciato da OpenAI a settembre.

“Questo è selvaggio e totalmente inaspettato”, ha scritto su X X Elvis Saravia, ricercatore sull’intelligenza artificiale e co-fondatore della società di consulenza AI con sede nel Regno Unito DAIR.

R1 si distingue per un altro motivo. DeepSeek, la start-up di Hangzhou che ha costruito il modello, lo ha rilasciato come “peso aperto”, il che significa che i ricercatori possono studiare e costruire sull’algoritmo. Pubblicato con una licenza MIT, il modello può essere riutilizzato liberamente ma non è considerato completamente open source, perché i suoi dati di formazione non sono stati resi disponibili.

“L’apertura di DeepSeek è abbastanza notevole”, afferma Mario Krenn, leader del Laboratorio di Scienziato Artificiale presso il Max Planck Institute for the Science of Light di Erlangen, in Germania. In confronto, o1 e altri modelli costruiti da OpenAI a San Francisco, in California, incluso il suo ultimo sforzo o3 sono “scatola essenzialmente nera”, dice.

DeepSeek non ha rilasciato l’intero costo dell’addestramento R1, ma sta caricando le persone che utilizzano la sua interfaccia intorno a un trentesimo di quanto costa l’o1 per funzionare. L’azienda ha anche creato mini versioni “distillate” di R1 per consentire ai ricercatori con una potenza di calcolo limitata di giocare con il modello. Un “esperimento che costa più di 300 sterline con o1, costa meno di 10 dollari con R1”, afferma Krenn. Questa è una differenza drammatica che giocherà sicuramente un ruolo nella sua futura adozione”.

Modelli di sfida

R1 è la parte di un boom nei modelli cinesi di grandi lingue (LLM). Spun out di un hedge fund, DeepSeek è emerso dalla relativa oscurità il mese scorso quando ha rilasciato un chatbot chiamato V3, che ha sovraperformato i principali rivali, nonostante sia stato costruito su un budget ridotto. Gli esperti stimano che sia costato circa 6 milioni di dollari per affittare l’hardware necessario per addestrare il modello, rispetto a oltre 60 milioni di dollari per Meta’ Llama 3.1 405B, che ha utilizzato 11 volte le risorse di calcolo.

Parte del ronzio intorno a DeepSeek è che è riuscito a produrre R1 nonostante i controlli delle esportazioni statunitensi che limitano l’accesso delle aziende cinesi ai migliori chip di computer progettati per l’elaborazione dell’IA. “Il fatto che provenga dalla Cina dimostra che essere efficienti con le tue risorse è più importante della sola scala di calcolo”, afferma Francois Chollet, ricercatore di intelligenza artificiale a Seattle, Washington.

I progressi di DeepSeek suggeriscono che “il leader percepito [che] gli Stati Uniti una volta si erano ridotti in modo significativo”, ha scritto Alvin Wang Graylin, un esperto di tecnologia in Bellevue, Washington, che lavora presso la società di tecnologia immersiva con sede a Taiwan HTC, su X. “I due paesi devono perseguire un approccio collaborativo per costruire un’IA avanzata rispetto al proseguimento dell’attuale approccio di gara di armi senza mano d’autore”.

Questa è una chiamata a morte per OpenAI:

Arnaud Bertrand @RnaudBertrand –

La maggior parte delle persone probabilmente non si rende conto di quanto sia una cattiva notizia per OpenAI il Deepseek cinese. Hanno ideato un modello che eguaglia e persino supera l’ultimo modello o1 di OpenAI su vari benchmark e stanno addebitando solo il 3% del prezzo.

È essenzialmente come se qualcuno avesse rilasciato un cellulare alla pari dell’iPhone ma lo stesse vendendo a $ 30 invece che a $ 1000.

È così drammatico.

Inoltre, lo stanno rilasciando open source, quindi hai anche l’opzione, che OpenAI non offre, di non utilizzare affatto la loro API ed eseguire il modello “gratuitamente” da solo. …

Anche la storia di DeepSeek è incredibile.

Nel 2007 tre ingegneri cinesi hanno deciso di creare un fondo quantitativo (speculazione finanziaria) utilizzando l’intelligenza artificiale.

Hanno assunto persone affamate appena uscite dalle università. Il loro fondo High-Flyer ha avuto un certo successo, ma negli ultimi anni il governo cinese ha iniziato a reprimere l’ingegneria finanziaria, il trading quantitativo e la speculazione.

Con il tempo a disposizione e la potenza di calcolo inutilizzata nella loro stanza sul retro, gli ingegneri hanno iniziato a costruire i modelli DeepSeek.

I costi sono stati minimi. Mentre OpenAI, Meta e Google hanno speso miliardi per costruire le loro IA, i costi di formazione per i modelli DeepSeek pubblicati sono stati di soli 5-6 milioni di dollari.

Perché a “loro” l’intelligenza Artificiale proprio serve. A cosa lo ha spiegato il caporione Larry Fink a Davos

BlackRock spiega perché lo spopolamento è una cosa positiva e perché per fortuna abbiamo l’intelligenza artificiale che può fare tutto il nostro lavoro.

BlackRock explaining why depopulation is a good thing and thankfully we have AI to do all your jobs. pic.twitter.com/riWfffPSyH

— illuminatibot (@iluminatibot) January 27, 2025

Ora l’Agenda 2030 è in pericolo?